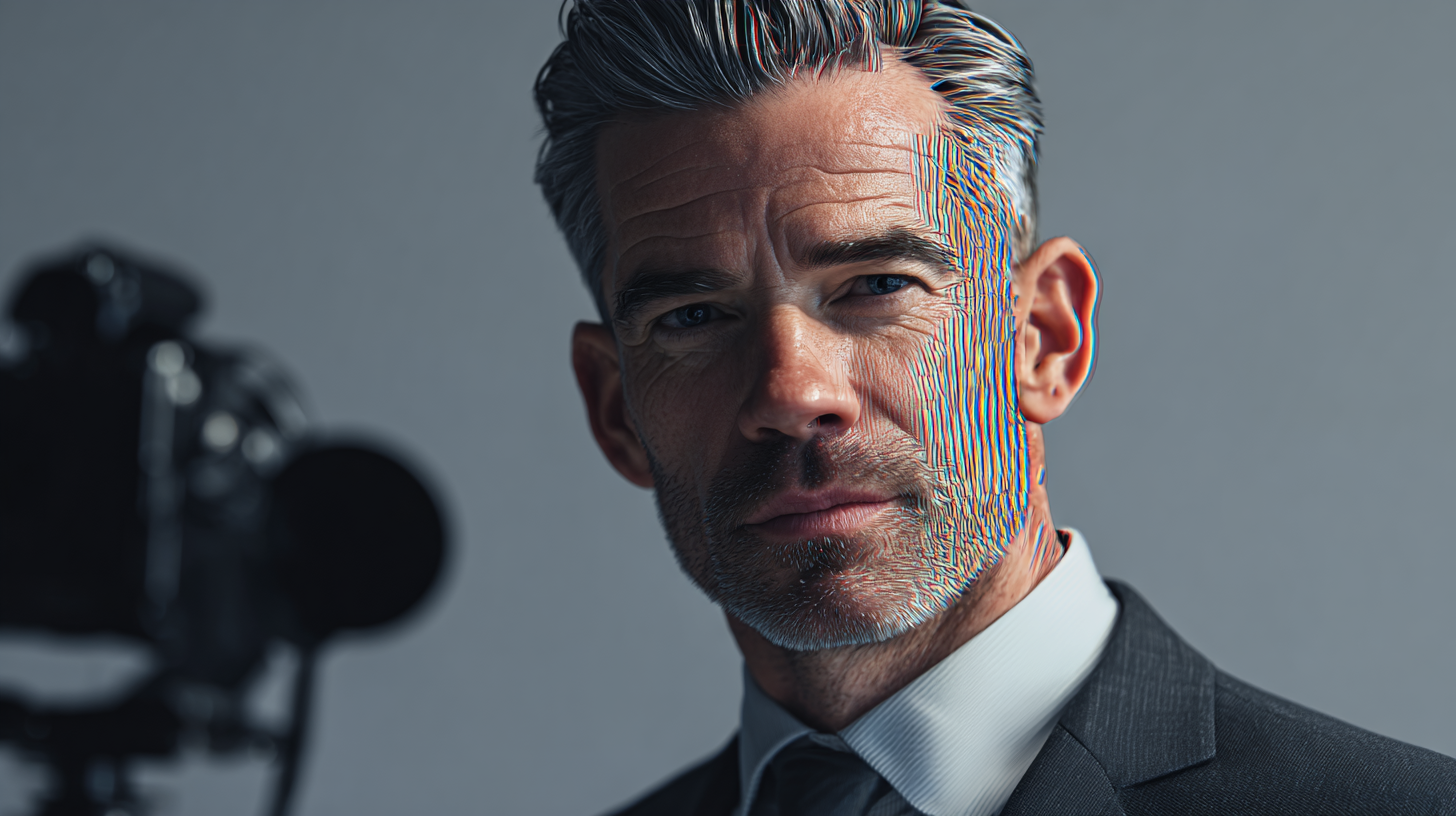

בעידן שבו כל אחד יכול לייצר סרטון בקלות שנראה כמו פרסומת, כתבה חדשותית, הרצאה רפואית או הצהרה פוליטית - קשה יותר מתמיד לדעת מה אמיתי ומה מזויף. כלים כמו Veo 3 של גוגל מאפשרים יצירת וידאו באיכות גבוהה בלחיצת כפתור, אבל יחד עם ההתלהבות מהחדשנות, מתרחבת גם התופעה המדאיגה: סרטוני בינה מלאכותית שמתחזים למציאות ומנסים להוליך אותנו שולל.

איך לזהות סרטוני AI? | ללא

סרטונים האלו לא רק מתחזים למשהו אמין, הם נראים בדיוק כמו מה שאנחנו רגילים לסמוך עליו: רופא בכיר, כתב שטח או מומחה לכלכלה. בסופו של דבר, המטרה של רבים מהם פשוטה להפליא - לגרום לנו להאמין, להתרגש, ולשלוף את כרטיס האשראי שלנו.

"המוח שלנו לא בנוי לזה"

"אנחנו בעידן חדש, שבו כל אחד יכול לייצר דמות משכנעת שאומרת כל דבר שהוא רוצה", אומר רועי שושן, ראש המחלקה הציבורית בפייק ריפורטר, ארגון ישראלי שהוקם על ידי פעילים, מומחים וחוקרי רשת כדי להגן על על החברה הישראלית מפני פעילות זדונית ברשת. "העין האנושית כבר לא מספיקה. המוח שלנו מאמין למה שהוא רואה, אבל מה שהוא רואה כבר מזמן לא חייב להיות אמיתי".

לדבריו, בתקופה האחרונה נרשמה עלייה בפניות מצד אזרחים שביקשו לוודא האם סרטונים שראו בטיקטוק, אינסטגרם או יוטיוב הם אותנטיים. "יש תחושת בלבול כללית. אם עד עכשיו התרגלנו להונאות טקסט - עכשיו שקרי הווידאו הם הדור הבא, והם הרבה יותר מסוכנים. כי הם נראים אמיתיים לגמרי".

אז איך מזהים?

לדברי שושן, קיימים כמה סימני אזהרה שיכולים לעזור לזהות סרטון שכולו או חלקו נוצר בבינה מלאכותית:

אין מקור ברור - "הדבר הראשון שאני מחפש זה מי עומד מאחורי הסרטון" - מסביר שושן. "אם אין שם של המרואיין, גוף שמזוהה עם הסרטון או אפילו קרדיט כלשהו - זו נורת אזהרה ברורה. ברוב הסרטונים הבעייתיים אין שום מידע מזהה".

אותו טקסט שוב ושוב - לדברי ג'ני דוברו, מתכנתת ויוצרת תוכן, אחת הדרכים הכי בולטות לעלות על זיוף היא פשוט לבדוק אם יש עוד סרטונים זהים: "ראיתי עמודים שבהם כמה דמויות שונות אומרות בדיוק את אותו הטקסט, מילה במילה - כאילו מדובר בשלושה רופאים שונים, אבל כולם חוזרים על אותו מונולוג. זה פשוט מועתק ומודבק בין דמויות שונות שנוצרו ב-AI".

פרופילים מחשידים - עוד סימן מחשיד היא העובדה שאין מענה לשאלות מהקהל בפרסום. "תכתבו בתגובות 'מי זה', 'איפה זה צולם', ולא תקבלו שום תשובה", אומר שושן. "האנשים שמפעילים את החשבונות האלה לא מעוניינים שתדעו מי הדמות או מה מקור התוכן. זה תוכן שתפקידו לבלבל, לא להסביר".

תחושה מוזרה - גם כשאין גליצ'ים בולטים, משהו עדיין מרגיש לא אנושי. דוברו: "לפעמים זו תנועה חלקה מדי, לפעמים הדיבור מהיר או מוזר, לפעמים הדמות מדברת בלי לעצור בין משפטים. יש מין קצב משונה כזה שלא מרגיש כמו בן אדם אמיתי. לפעמים זה רק מבט חלול או הבעה שלא משתנה. זה לא תמיד בולט, אבל אם משהו מרגיש לא טבעי, שווה לעצור ולחשוב".

מה עושים?

לדברי שושן, ההתמודדות עם סרטוני בינה מלאכותית מזויפים לא יכולה להישען רק על אחריות אישית. "צריך להסדיר את זה ברמה רגולטורית", הוא מדגיש. "החברות שמפתחות את הכלים האלה חייבות לקחת אחריות, אבל גם המדינה צריכה להיות שם עם חוקים ברורים שיחייבו שקיפות, סימון, ואיסור הפצת תוכן מזויף שפוגע באנשים. אסור להשאיר את השוק הזה פרוץ".

הציבור חייב ללמוד לזהות

במקביל, שושן מדגיש את האחריות שלנו כמשתמשים. "אנחנו צריכים לדעת לשאול שאלות, לפקפק, לא למהר לשתף. מי שצורך מידע ברשת חייב להבין שהעיניים כבר לא יכולות לבד לזהות מה אמיתי. זה אומר לחנך, להנגיש כלים, ולחזק ארגונים שיכולים לעזור באימות. לא מדובר בפחד מהעתיד אלא בהבנה שאנחנו כבר חיים בעידן הטכנולוגי הזה".

ולמרות הכול, גם שושן וגם דוברו מדגישים: לא מדובר באויב. "בינה מלאכותית היא כלי מדהים". אומרת דוברו. "אבל כמו סכין - היא יכולה לחתוך סלט, או לפגוע בגוף. זה תלוי במי שמחזיק אותה".

טעינו? נתקן! אם מצאתם טעות בכתבה, נשמח שתשתפו אותנו

![[object Object]](/wp-content/uploads/2024/05/15/06/whatsapp-israelhayom-m-150-.gif)